Dans la continuité des éditions des Techdays, les Microsoft expériences 2017 se sont tenues le 3 et 4 Octobre dernier au Palais des Congrès à Paris. Cette grand-messe des aficionados Microsoft avait pour but de présenter les tendances et orientations de la Firme de Redmond. MonWindows était présent pour vous retransmettre l’essentiel de cet événement.

Microsoft Experiences 2017 en chiffres

- 10 000 m2 d'espace pour échanger sur les technologies numériques.

- 300 intervenants

- 15 000 visiteurs

- 2 séances plénières

- 256 ateliers ou talk sessions

- 2557 litres de café bu (dont une bonne moitié par votre serviteur)

« Empower every person and organization to achieve more».

Si ce leitmotiv peut sembler de prime abord un peu « ronflant», voir sorti d’une fin de soirée de publicistes aux Bains-douches vers 5h du matin, une fois que l’on s’attarde sur l’articulation des axes technologiques présentées, il semble être en total adéquation avec la ligne « Cloud first/mobile first » que le CEO de Microsoft a élevé en paradigme de la firme. Car Nadella est bien l’homme du Cloud, et beaucoup moins celui du hardware comme nous avons pu tous nous en rendre compte avec l’abandon de la branche mobile. Une fois la frustration passée, faut-il encore se demander pourquoi ?

Enfonçons tout d’abord quelques portes ouvertes et essayons de trouver un peu de lumière au fond du couloir.

- Première porte ouverte, la page Ballmer de Microsoft est belle et bien tournée. Les choix effectués par Nadella (dont certains ont été initiés tout de même par son prédécesseur) depuis 2014-2015 prennent tous leurs sens et donnent une idée assez claire de l’évolution du modèle de la Firme à court et moyen terme. Avec son « Empower every person and organization to achieve more », autrement dit, « permettre à chaque personne et organisation de réaliser plus », Microsoft ambitionne de devenir un acteur central de la transformation numérique de la société dans toutes ses composantes. Vaste programme…. L’idée générale est que l’arrivée de l’Intelligence artificielle va créer un bouleversement sans précédent dans tous les pans de la société, de l’organisation du travail à l’environnement, de la santé aux usages les plus basiques que nous entretenons avec nos objets du quotidien. Et Microsoft veut en être.

- Deuxième porte ouverte, pour réaliser cette ambition Microsoft mise tout sur le Cloud, au service de l’IA dans un but affiché d'« amplifier l’ingéniosité humaine et non de la remplacer » … Mais, au-delà des mots, comment lire la feuille de route de Microsoft ?

Investissement & Partenariats

Peggy Johnson (VP Business Developper) nous éclaire un peu plus sur les axes de la stratégie de développement de Redmond. Premièrement, Microsoft continuera d’investir dans le développement cloud et software en interne, mais également dans le cadre de rachat et de prise de participation dans des entreprises et start-up orientés sur ce secteur. Deuxièmement, ce volet investissement s’accompagne d’un volet partenariat assez étoffé. Il semble que les récentes ouvertures initiées par Nadella vers Linux, Google ou Apple marque une inflexion du modèle « propriétaire » de la corporation et le portage des suites logiciels Microsoft auprès de ces deux derniers montre la volonté de Microsoft d’être présent sur le plus de supports possible, notamment mobiles. Ce n’est pas le mobile First que nous espérions mais il s’agit d’une nécessité dans le plan de Microsoft pour asseoir son modèle de développement sur l’IA et le Machin Learning.

Peggy Johnson s’est également félicitée du partenariat avec Amazon, partenariat qui pourrait s’annoncer plus étendu que le simple mariage de leurs assistants personnels et leur permettre de démultiplier la puissance de leur Cloud respectifs. D’autre partenariats avec de Grandes entreprises telles Schneider Electric, ADECCO ou encore Publicis sont en cours ou déjà réalisés pour amener de nouvelles "way of work". A ce titre, l’accord de partenariat signé en mars dernier entre Microsoft et Publicis sur la création de la future génération de solutions intelligentes sur le cloud afin d’accélérer la transformation numérique des entreprises, en est une concrétisation des plus éclairante.

Une chose est certaine, sous l’impulsion de son CEO, Microsoft Azure et Cortana intelligence tiendront une place centrale dans l’orientation stratégique de Microsoft dans les années à venir, sans doute aux dépends de la branche hardware, reléguée au troisième voir quatrième plan. Dans cette configuration, il va de soit que la ressource principale, vitale pourrait-on dire, est et demeure la DATA, matière première des algorithmes nécessaire à la démocratisation d'une IA sensée amplifier l’ingéniosité humaine.

Une IA pour les gouverner tous, une IA pour les trouver. Une IA pour les amener tous et ….. dans le cloud, les lier.

Une fois ce schéma de développement acté, au grand damne des pauvres amateurs de hardware Microsoft que nous sommes, il apparaît également que Redmond anticipe déjà l’étape suivante de l’évolution de la sacrosainte trinité « Cloud Data/SaaS/Mixed Reality » en posant les pierres d’un futur MLaaS, (Machin Learing as a Service).

Récemment, Elon Musk a jeté un pavé dans la marre des DATA en s’interrogeant publiquement sur les finalités de l’IA. Si je ne disconviens pas des risques inhérents à l’avènement de programmes intelligents pensant et agissant à la place de l’homme, force m’est de constater que l’IA peut apporter une réelle plus-value à l’organisation des activités humaines. Encore faut-il être d’accord sur la notion d’IA et le niveau de cette IA.

Microsoft souhaite donc amplifier l’ingéniosité humaine et les presque 256 sessions et talks de ces deux jours de Congrès montraient de manière assez pratiques les gains que les intelligences Artificielles peuvent apporter dans la Santé, le social, les RH, l’environnement, l'industrie, le commerce, l'éducation... etc.

Panorama de projets sur l'IA et la MR.

Santé

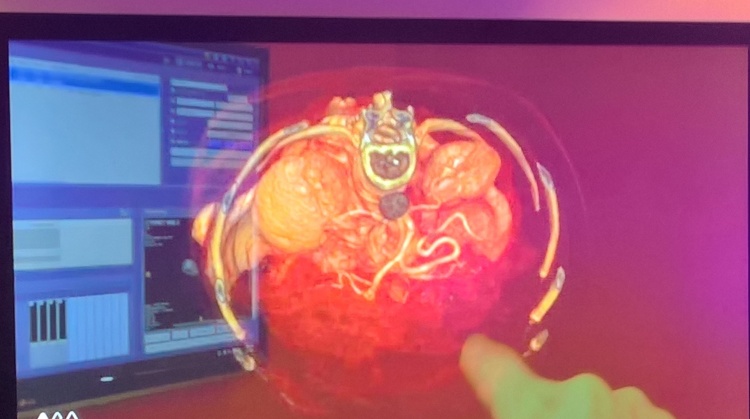

Le 21 novembre aura lieu une première mondiale. Une opération chirurgicale

sous HOLOLENS. L'opération de pose de prothèse d'épaule se déroulera en direct sur trois continents. Le

Docteur Thomas Grégory de l’hôpital Avicenne opérera avec HOLOLENS en

lien simultané avec des professeurs d’Universités situés aux USA, en

Angleterre et en Corée du Sud. D’après Gaël Khun, de Tera Recon,

les progrès réalisés sur les opérations assistés sont significatifs et l’on

peut s’attendre à voir se démocratiser ce type d’outils qu’ils soient

holographiques ou robotique en chirurgie invasive.

L'imagerie 3D est gérée dans le cloud et le ou les chirurgiens peuvent appréhender le modèle sous tous les angles pour déterminer la meilleure voie d'intervention. Pendant l'opération, l'hologramme est inséré en surimpression sur le patient pour une meilleure précision du chirurgien. A termes, et connecté au cloud de l'hôpital, il sera possible de faire une acquisition 3D des opérations réalisées pour permettre des diagnostics post opératoires plus efficaces et des ré-interventions plus rapide sans avoir besoin de faire repasser le patient par différents services. On pourrait diminuer les temps d'hospitalisation de 7 à 3 jours sur certains type d'opérations, ce qui n'est pas négligeable considérant la surcharge récurrente de nos hôpitaux.

Pour ceux qui s’interrogent sur les risques liés aux transferts de flux de données et de la continuité du signal pendant ces opérations assistées, des protocoles de sécurités sont prévus pour permettre la gestion en local.

Ainsi, si l’imagerie type HOLOLENS est en transfert quasi instantané (de l’ordre de 30 millisecondes), pour l’assistance robotisé à distance, il est prévu de descendre le cloud au niveau local avec une continuité de fonctionnement en mode dégradé.

Industrie

Naval Group, leader européen du naval de défense teste une solution HOLOLENS pour l’assistance à la construction et la maintenance de navires. Le programme permet aux intervenants de disposer en temps réel d’intervention des schémas de montage et disposent des images des éléments futurs à monter, les pièces inaptes au service ou les incidents potentiels retardant le chantier.

Egalement AREVA a déployé un programme assez similaire avec des équipes de maintenance sous HOLOLENS pour permettre aux opérateurs de terrain de gagner en autonomie lors des interventions en milieu contraint. Yves André, directeur Stratégie des services nucléaires France, indique ainsi que l’accès à la documentation, les contacts audio et visuel avec des experts métiers en temps réel leur permettent d’intervenir en toute liberté de mouvements pour plus de sécurité et avec un temps d’exposition au risque réduit.

Organisation du travail

J’aurais pu vous parler longuement du projet ShakHR (« shaker »), mis à l’honneur lors de la première séance plénière. Ce projet est mené par l’ancien Directeur des achats de L’Oréal, Romain Trébuil et élaboré en partenariat avec The Group ADECCO et Microsoft. Il vise à rapprocher les grands groupes et les travailleurs indépendants via une plate-forme permettant aux indés et freelance de trouver des missions, accélérer les délais de paiement et bénéficier d’un accompagnement administratif juridique et comptable. Date de sorti prévu pour le 14 Novembre de cette année.

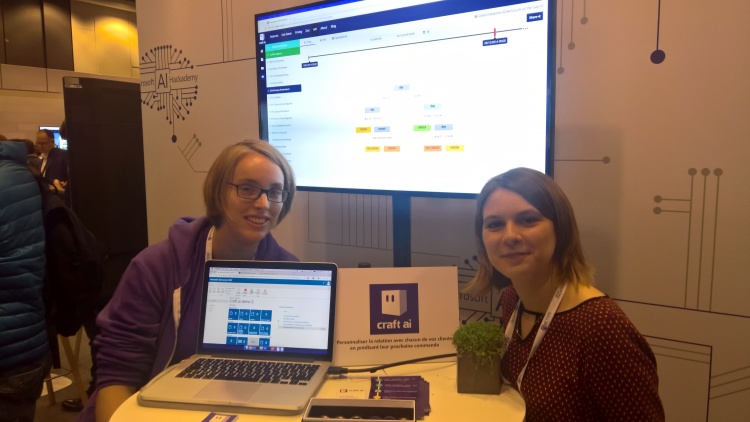

Mais je préfère mettre à l’honneur une jeune start-up nommée Craft AI, tant leur projet résonne pour l’un des secteurs d’activité qui me concerne. Craft AI propose du « Learning machin » via une API d’intelligence artificielle. Cette API d’Intelligence Artificielle “as-a-service” permet aux services d’apprendre en continu pour personnaliser l’expérience de chaque utilisateur et automatiser des tâches complexes. Une fois dit ça vous me répondrez, « ok ! mais à quoi ça sert ? ».

Pour une de nos entreprises qui est spécialisée sur les services aux personnes âgées dépendantes et personnes en situation de handicap, la gestion du planning est chronophage. Passée une taille de 100 salariés, 35% du temps des administratifs est dédié à la planification et la correction de la planification (absentéisme, arrêts maladie, AT, congés, absences injustifiés, correction des scans d'intervention…etc). Mais mettre de l’humain en relation avec de l’humain demande une sensibilité qui ne se limite pas à l'analyse des diplômes, compétences ou de l’expérience. La problématique étant de garder une continuité dans la qualité de la prise en charge du bénéficiaire. Un intervenant X sera bien accepté chez le bénéficiaire alors qu’un intervenant Y, ayant les mêmes qualifications, la même expérience etc… ne le sera pas.

Une AI comme Craft AI peut en théorie apprendre de l’utilisateur qui effectue les programmations des plannings, en vue d’établir des scénarii de placement des intervenants en fonction de critères plus profonds (deep learning) que les compétences, le niveau de diplôme ou l’expériences. En automatisant l’aide décision, il est possible de diminuer le temps dédié à la planification à 15% à 20%, et de dégager du temps pour d’autres activités liées au développement de l’entreprise (réunions partenariales, commercial, suivi qualité …Etc). On peut même envisager beaucoup plus en optimisant le rapport entre AI et ERP et arriver à une programmation et une correction automatique de la planification. A noter, Craft AI fait tourner sa « Machin learning» dans un cloud Amazon m’a-t-on dit.

Sociale

Coup de chapeau sur une technologie sur laquelle d’autres grands de l’informatique planchent également (et déjà présente lors des éditions des Techdays précédentes) mais dont les avancées et la démonstration effectuée par Harry Shum, (VP research division) sont réellement impressionnantes.

La version proposée de Translator offre une traduction quasi simultanée du chinois à l’anglais avec très peu de temps de latence. En Aout dernier, l'équipe de Microsoft a réussi à descendre le taux d'erreur à 5.1%. Lorsque la puissance du Cloud viendra à bout de des expressions idiomatiques, nos sociétés abrogeront enfin la barrière multi séculaire du langage.

A noté que l'équipe a travaillé à partir du CNTK, Microsoft Cognitive Toolkit, un outil gratuit et open source qui permet d'améliorer l'entrainement des algorithmes.

Dérivé de cette

technologie, Presentation Translator est un complément PowerPoint qui

permet d’ajouter des sous-titres en temps réel à votre présentation et de

traduire le texte de votre document PowerPoint dans plus de 60 langues.

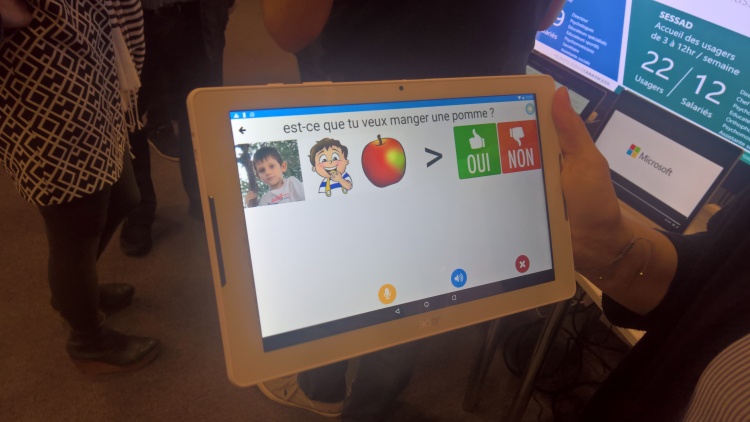

Spécial "Big Up" pour une application utilisant une IA permettant de faciliter la communication avec les enfants autistes, la bien nommée HELPICTO. Cette application mobile multiplateforme, développée par Equadex et l’association Inpacts 31, permet de faciliter l’échange et la communication entre les enfants autistes et leur entourage. L'idée est de développer une solution qui facilite la communication entre des personnes présentant des troubles du langage et leur entourage, médical ou familial.

Il s'agit de remplacer les classeurs à pictos, qui utilisent des images de la vie courante pour aider les enfants autistes à communiquer, par une application logicielle qui associe à la fois la reconnaissance vocale et la reconnaissance d'images. Le croisement des data permet d’enrichir la base de vocabulaire et syntaxique pour générer plus facilement des phrases et passer du phrasé au picto, et inversement.

Productivité

Un soft a suscité beaucoup d’intérêt dans le domaine de la Vidéo. Vidéo Indexer permet d’effectuer des recherches à partir de mots clefs dans une vidéo et de retrouver les moments de la vidéo où les mots clefs sont présents. Vidéo Indexer propose également une traduction de la vidéo visionnée. Cet outil est vraiment impressionnant et est disponible en préview. Un futur Must have !

Enfin, un dernier mot sur les chatbots intelligents, bien représentés sur le salon et focusés à travers un partenariat entre Microsoft et la Plateforme Stack Overflow, bien connue de la communauté des développeurs. Microsoft AI propose des outils comme Bot Framework, Cognitive Services, Cognitive Toolkit, Azure Machine Learning etc… pour permettre aux développeurs de rapidement intégrer l'IA dans leurs applications et solutions existantes, et créer de nouvelles expériences intelligentes pour leurs utilisateurs. Dans ce cadre, un Stack Overflow bot, qui s’appuie sur le "Microsoft Program Synthesis using Examples SDK " (Prose SDK) a été créé pour faciliter l’intégration de l’AI dans le développement d’applicatif. Via Stack Overflow bot, le kit permet de générer du code. Pour vulgariser, l’utilisateur interroge le bot pour l’assister à l’écriture d’un script, soit le bot propose d’affiner l’algorithme, soit il propose directement du code sous forme de script

La dernière frontière, le qubit ?

Nous pourrions digresser à envie sur l’industrie, les New Way of Work, l’Energie, les ressources Humaines, le marketing, le Commercial, la formation, l’apprentissage, l’accessibilité, la domotique, le loisir et le tourisme etc… tant les projets étaient nombreux et avec chacun leur particularisme lié au Cloud Computing, la MR ou l’IA….

Et s’il fallait se convaincre une dernière fois que l’ambition de Microsoft est de démocratiser l’IA et de la placer dans tous ses produits et dans tous les foyers/bureaux, il suffit d’écouter à nouveau Harry Shum sur le devenir de la recherche chez Microsoft.

Il pense que nous sommes arrivés à un moment disruptif dans l’évolution de la technologie. Cela se traduit déjà dans l’organisation des entreprises. Certaines ont déjà commencés comme les banques, les assurances, les transports …et bientôt cela touchera tous les secteurs d’activité et la société en général.

Aujourd’hui le regard de Microsoft se porte sur le Machin learning, dans un but évident de développer du MLaaS. Pour cela, Microsoft doit améliorer trois facteurs qui ont rendu la démocratisation de l’IA possible :

- L’augmentation des capacités du cloud

- Le perfectionnement des algorithmes qui arrivent aujourd’hui à maturité

- L’augmentation de la masse de data disponible pour exploiter le deep learning

Pour cela, la puissance de calcul nécessaire au traitement de ces données nécessite la mise au point de super ordinateur … plus connu sous le nom d’ordinateur quantique. Je ne vais pas m’appesantir sur un domaine extrêmes technique mais tout du moins présenter le choix technologique fait par Microsoft en ce domaine.

Un ordinateur quantique repose sur des propriétés quantiques de la matière : superposition et intrication d'états quantiques. Développé depuis les années 1990, certains algorithmes conçus pour la logique des ordinateurs quantiques rendent possible des calculs inimaginables avec un ordinateur classique. La création d’un ordinateur quantique est complexe et nécessite des métiers et compétences en physique, cryogénie, mathématique développement, programmation etc…

La difficulté majeure d’un tel système concerne la réalisation physique de l'élément de base de l'ordinateur quantique : le qubit. Alors qu’en informatique « classique », un bit peut prendre les valeurs « 0 » ou « 1 », en informatique quantique, le qubit peut avoir une valeur de « 0 », « 1 » ou bien les deux en même temps. Les possibilités de calculs s’en trouvent décuplés.

Le phénomène de « décohérence », c’est-à-dire de perte des effets quantiques sur le long terme, est le principal frein au développement de l'ordinateur quantique. En effet, dès que l’on modifie l’état d’un qubit, l’information est dégradée ou détruite. (Imaginez que vous enregistriez un document Word après l'avoir modifié, et que tout le document s’efface).

Il existe plusieurs types de qubit qui ont chacun un degré de décohérence plus ou moins prononcé. Microsoft a choisi de travailler sur les qubits dits Topologiques à partir des travaux sur le fermion de Majorana découvert à l’université de Santa Barabara en 2012. Ce qubit à la particularité d’être plus stable.

Bernard Ourghanlian (Directeur Technique t Sécurité) y voit un formidable potentiel pour l’avenir de nos sociétés. Un ordinateur de 10 à 50 qubit pourrait résoudre les problématiques de fixation de l’azote, un ordinateur quantique développant 100 à 1000 qubit permettrait de résoudre la problématique de capture de CO2 et faciliter l'élaboration de nouveaux matériaux supraconducteur etc...

Conclusion

En résumé, et nous l’avons bien senti tout au long de ces deux jours, l’avenir de Microsoft selon Nadella sera celui du SaaS, de la Réalité Mixe et de l’IA le tout boosté par la puissance du Cloud et d’Azure. Le chemin ne me semble pas si long quant à voir notre quotidien, que ce soit au travail ou à la maison, bousculé par ces avancées.

Mais l’arrivée de ces technologies dans notre quotidien n’est rendue possible que grâce à la collecte et au traitement des DATA, que nous donnons volontairement ou involontairement. Le pas suivant nécessitera, à n’en pas douter, la collecte systématique de toutes les données nous concernant…. Mais encore faudrait-il personnellement, en tant qu'individu, être prêt à laisser ces données accessibles à ceux qui veulent nous vendre un futur meilleur ?

Et vous, êtes-vous prêts à donner plus de données personnelles si cela permet de faire progresser « l’ingéniosité humaine » ?

Voir les commentaires